算法革命还是硬件寒冬?谷歌TurboQuant背后的真相与悖论

当谷歌发布TurboQuant技术方案时,硅谷乃至全球资本市场瞬间陷入了恐慌。该方案声称能将大语言模型推理阶段的键值缓存需求削减至原来的六分之一,并在英伟达H100GPU上实现了惊人的八倍推理速度提升。这一消息直接导致存储板块在美股市场遭遇抛售,投资者似乎笃定:既然算法效率大幅提升,那么对昂贵的存储芯片需求必然萎缩。然而,这种线性思维在复杂的半导体产业逻辑面前,显得过于单薄且缺乏前瞻性。

任务设定:重新审视技术效率的边界

我们需要通过拆解TurboQuant的实际应用场景来验证市场担忧是否成立。首先,该技术仅针对推理阶段的键值缓存进行压缩,它并不触及模型训练阶段对海量数据存储的刚性需求。其次,推理效率的提升意味着单台GPU能处理的任务量剧增,这实际上降低了单位算力的运营成本。如果我们将视角拉长,会发现这并非存储需求的终点,而是新一轮算力扩张的起点。市场在评估硬件需求时,往往忽视了“杰文斯悖论”这一经济学规律的深远影响。

步骤分解:为何效率提升反而催生硬件需求

第一步是成本敏感度分析。当推理成本下降,此前因算力成本过高而无法落地的长文本AI应用将大规模涌现。第二步是应用场景的边界外溢。从简单的文本问答到复杂的实时数据分析,AI应用的广度与深度将呈指数级增长。第三步是资源消耗的重构。虽然单位Token的存储消耗减少了,但由于Token的总需求量呈几何倍数增长,硬件的总负载不降反升。数据模型显示,在类似技术迭代周期中,应用普及率的提升往往能抵消掉单点效率优化的影响,最终推高资源总消耗。

执行要点与常见问题

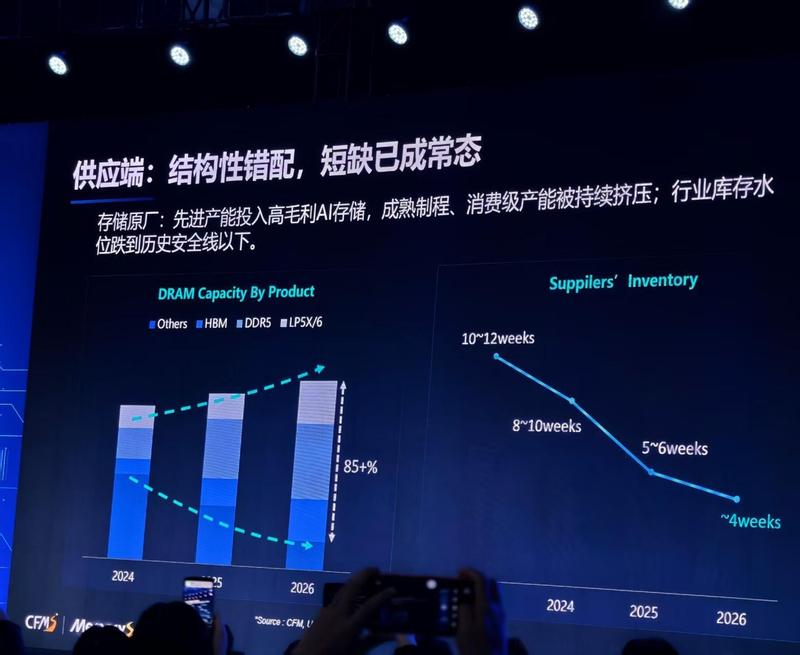

在分析此类技术变革时,必须区分“单位效率优化”与“总量需求萎缩”。市场常见的误区在于将局部算法优化等同于全产业链的产能过剩。事实上,存储产业链的核心逻辑依然由AI大模型的训练规模、上下文窗口的长度以及端侧AI设备的普及率共同决定。只要模型参数规模仍在持续扩大,只要多模态数据处理需求仍在激增,存储硬件的战略地位就难以撼动。

进阶优化:理性看待板块波动

对于投资者而言,当前的板块调整恰恰提供了布局机会。存储行业的基本面并未因一个算法优化而发生断裂。反之,随着AI生态通过TurboQuant类技术降低门槛,更多的应用场景将转化为真实的算力与存储订单。在审视存储产业链时,应重点关注那些具备高带宽内存(HBM)技术储备及先进封装能力的头部企业,它们才是这场效率革命背后真正的受益者。切勿被短期市场情绪误导,忽视了长周期下的产业红利。